Möglichkeiten, persönliche Erfahrungen und die ehrlichen Risiken

Zur Einordnung dieses Textes

Dieser Artikel ist ein persönlicher Erfahrungsessay – geschrieben aus der Perspektive einer Betroffenen, nicht aus der einer Fachperson. Ich bin keine Therapeutin, keine Psychologin, keine Forscherin. Ich bin jemand, der psychische Erkrankung am eigenen Leib erfahren hat und dabei begonnen hat, Künstliche Intelligenz als Teil seines Alltags zu nutzen – bewusst, reflektiert und immer eingebettet in eine laufende Therapie.

Was ich hier beschreibe, sind eigene Erlebnisse, eigene Schlussfolgerungen und ein Versuch, aktuelle wissenschaftliche Erkenntnisse neben diese persönlichen Erfahrungen zu stellen. Wo ich auf Studien und Fachliteratur verweise, tue ich das, um meine Beobachtungen einzuordnen – nicht, um wissenschaftliche Autoritaet zu beanspruchen, die mir nicht zusteht.

Ich schreibe diesen Text, weil ich glaube: Menschen, die selbst betroffen sind und sich gleichzeitig kritisch mit KI auseinandersetzen, haben eine Stimme in dieser Debatte, die häufig fehlt. Die Diskussion über KI in der Psychotherapie wird oft entweder von Tech-Enthusiasten oder von skeptischen Fachleuten geführt. Die Perspektive derer, die mittendrin sind, kommt zu selten vor.

Wie es begann – ein Abend mit Mr. Ping

Es war ein Abend, an dem ich nicht mehr weiterwusste. Meine Therapeutin hatte mir in der letzten Sitzung eine Methode mitgegeben, die sich Externalisierung nennt: einen inneren Anteil nach aussen stellen, ihm einen Namen geben, damit er nicht mehr das ganze Innere ausfüllt, sondern zu etwas wird, mit dem man sprechen kann. Mein innerer Anteil bekam einen Namen, der mir sofort passte: Mr. Ping.

Wer Kung Fu Panda kennt, weiss: Mr. Ping ist der Adoptivvater des Pandabären Po. Kein Held, kein Krieger. Ein einfühlsamer, weiser, leicht nervöser Gastwirt, der seinen Sohn bedingungslos liebt – auch dann, wenn der Sohn sich selbst am liebsten aufgeben würde.

An jenem Abend, als ich wieder einmal extrem brutal mit mir umging und mich innerlich vollständig fertigmachte, öffnete ich keinen Freund, kein Buch, keine Hotline. Ich öffnete einen Chat – und fragte: Was würde Mr. Ping jetzt zu mir sagen?

Was dann folgte, hat mich verändert. Nicht weil die KI besonders klug war. Sondern weil sie mich dazu gebracht hat, die Antwort selbst zu finden.

Ich hatte den Chat so konfiguriert – man nennt das Prompting –, dass er eine einzige Frage kennt: “Was würde Mr. Ping jetzt zu dir sagen?” Der entscheidende Mechanismus: Ich antworte selbst. Der Chat greift nicht sofort ein. Erst wenn ich zwei- oder dreimal selbst keine Antwort mehr finde, macht er einen Vorschlag in der Stimme von Mr. Ping.

Das ist keine Spielerei – zumindest nicht nur. Die Methode der Externalisierung kommt aus der Narrativen Therapie und dem IFS-Ansatz (Internal Family Systems) nach Richard Schwartz. Die Kernidee: Wenn ein innerer Anteil – besonders ein kritischer, strafender – als eigenständige Figur betrachtet werden kann, verliert er seine totalisierende Macht. Ich tue das, was ich sonst in meinem Kopf machen würde – aber jetzt passiert es im Dialog. Aussen. Sichtbar. Die KI ist dabei ein externer Resonanzraum, der die Frage hält.

Was mir in diesen Momenten geholfen hat, ist nicht das, was die KI gesagt hat. Es ist das, was ich gesagt habe – mit ihrer Hilfe.

Wichtig: Ich habe diesen Chat niemals anstelle meiner Therapie genutzt. Er war das, was er sein soll – eine Brücke. Zwischen den Sitzungen, zwischen dem Wissen aus der Therapie und dem Moment, in dem ich es brauchte.

Der Bedarf, der längst existiert

Bevor wir über KI in der Psychotherapie sprechen, muss ein unbequemer Satz ausgesprochen werden: Viele Menschen sprechen bereits mit KI über ihre psychischen Probleme – und das nicht, weil sie es für die beste Lösung halten, sondern weil es die verfügbare ist.

Die Wartezeiten auf einen Therapieplatz betragen in Deutschland, Österreich und der Schweiz häufig sechs bis zwölf Monate, in ländlichen Regionen noch länger. In dieser Zeit sitzen Menschen mit ihrer Angst, ihrem Trauma, ihrer Verzweiflung – und tippen ihre Gedanken in ein Chatfenster. Laut dem AI Report 2025 der Plattform It’s Complicated tun das bereits heute viele Menschen, bewusst oder unbewusst.

ChatGPT, Claude, Gemini – diese Systeme wurden nicht als Therapieprogramme entwickelt. Und doch landen dort täglich Nachrichten wie: „Ich weiss nicht mehr weiter.“ Die Diskussion darüber, ob das gut oder schlecht ist, übersieht, dass es längst Realität ist.

In der Versorgungsforschung wird KI meist als Bestandteil von Digital Mental Health verstanden – als Baustein in hybriden Versorgungsmodellen, die als Blended Care bezeichnet werden: digitale Tools ergänzen analoge Psychotherapie, etwa zur Überbrückung von Wartezeiten, für Psychoedukation oder zur Stabilisierung zwischen Sitzungen (AOK G+G, 2026; Psychotherapeutenjournal, 2025; World Economic Forum, 2025).

Die entscheidende Frage ist nicht mehr, ob KI eingesetzt wird. Sie lautet: Wie gestalten wir es verantwortungsvoll – und was müssen wir dabei ehrlich benennen?

Was KI im therapeutischen Kontext leisten kann

KI ist kein Therapeut. Das muss klar sein und bleibt der Ausgangspunkt jeder seriösen Betrachtung. Aber KI kann an verschiedenen Stellen des therapeutischen Prozesses eine sinnvolle Ergänzung sein – wenn sie bewusst, reflektiert und fachlich eingebettet eingesetzt wird.

Reflexion zwischen den Sitzungen

Therapie findet einmal pro Woche statt – wenn man Glück hat. Was passiert in den anderen 167 Stunden? In vielen Fällen: nichts Strukturiertes. Hier kann KI als Reflexionspartner helfen: Gedanken sortieren, Muster benennen, Emotionen einordnen. Nicht als Ersatz für die nächste Sitzung, sondern als Vorbereitung darauf. Als Tagebuch, das zurückfragt. Ich habe das selbst so erlebt: KI hat mir oft geholfen, klarer und vorbereiter in eine Therapiesitzung zu gehen.

Psychoedukation und niedrigschwellige Orientierung

„Was ist eine Panikattacke?“ „Ist es normal, dass ich mich nach der Sitzung erschöpft fühle?“ Fragen wie diese stellen Menschen täglich. KI kann Wissen vermitteln und normalisieren – ohne Wartezeit, ohne Scham. Das gilt besonders für Menschen, die noch keinen Therapieplatz haben oder nicht sicher sind, ob sie überhaupt Hilfe suchen wollen.

Studien zu KI-gestützten Chatbot-Interventionen zeigen bei leichten bis moderaten depressiven Symptomen und Stressbelastung positive Effekte, mit kleinen bis mittleren Effektstärken. Die Woebot-Studie (Fitzpatrick, Darcy & Vierhile, JMIR Mental Health, 2017) zeigte in einer randomisierten kontrollierten Studie signifikante Reduktionen depressiver Symptome innerhalb von zwei Wochen. Ähnliche Befunde werden für andere Tools wie Wysa berichtet.

Wichtige Einschränkung: Die Forschungslage ist noch begrenzt. Viele Studien sind klein, methodisch heterogen und beschränken sich auf kurze Zeiträume von vier bis zwölf Wochen. Zu Langzeiteffekten, Rückfallraten und dem Einsatz in komplexen klinischen Kontexten liegt kaum belastbare Evidenz vor (Frontiers in Psychiatry, 2025; PMC, 2025). Das ist kein Argument gegen den Einsatz von KI – aber ein starkes Argument für Vorsicht und Begleitung.

Therapeutische Methoden verlängern

Bestimmte therapeutische Methoden – kognitive Umstrukturierung, Achtsamkeitsubungen, Externalisierungstechniken – lassen sich durch KI begleiten. Nicht im Sinne von „die KI führt die Therapie durch“, sondern: „Die KI ermöglicht dem Menschen, eine Methode, die er in der Therapie gelernt hat, selbst anzuwenden.“ Das war meine Erfahrung mit Mr. Ping. Das Prinzip gilt vor allem für strukturierte, verhaltensnahe Ansätze wie die kognitive Verhaltenstherapie, weniger für tiefenpsychologische Arbeit mit Übertragung und Gegenübertragung.

Neue Schnittstellen: Wearables und Sprachanalyse

Neben Chatbots öffnen sich weitere digitale Schnittstellen: Wearables können physiologische Stressmuster sichtbar machen, Sprachanalyse-Systeme stimmungsbasierte Veränderungen erkennen. Diese Entwicklungen sind noch jung und brauchen intensive fachliche Begleitung – aber sie zeigen, in welche Richtung sich das Feld bewegt.

Entlastung für Fachpersonen

Auf der anderen Seite des Schreibtisches: KI kann Dokumentation, Verlaufsnotizen und Anamnesevorbereitungen unterstützen. Das ist weniger glamörös, aber relevant. In einer Branche mit hohen Burnout-Raten kann administrative Entlastung mehr Zeit für das Wesentliche schaffen: die therapeutische Beziehung.

Für wen KI sinnvoll ist – und für wen nicht

Das vielleicht wichtigste Kapitel. KI ist nicht für alle Anliegen und alle Menschen gleich sinnvoll. Eine nüchterne Einschätzung der Indikation ist unverzichtbar.

Eher geeignet: niedrigschwellige, strukturierte Anliegen bei stabilem Zustand. Leichte bis moderate depressive Verstimmungen, Alltagsstress, Angst in klar abgrenzbaren Situationen, Schlafprobleme, Begleitung von Psychoedukation. Ausserdem: die Reflexion zwischen Sitzungen, die ich selbst genutzt habe.

Deutlich weniger geeignet oder kontraindiziert: komplexe Traumafolgestörungen, schwere Persönlichkeitsstörungen, akute Psychosen, Suizidalität und Fremdgefährdung. Diese Situationen brauchen menschliche Präsenz, klinische Urteilsfähigkeit und klare Verantwortungsstrukturen. KI kann hier nicht einspringen – und sie darf es nicht vertäuschen.

KI erkennt keine echte Krise. Sie kann keine Suizidalität zuverlässig einschätzen, niemanden anrufen, niemanden halten. Das ist keine behebbare Schwachstelle, sondern eine strukturelle Grenze. Sie darf niemals als Sicherheitsnetz in kritischen Situationen gedacht werden (PMC, 2025).

Die Risiken – ohne Schönreden

Jede ernsthafte Auseinandersetzung mit den Möglichkeiten von KI verpflichtet zur Ehrlichkeit über ihre Risiken. Ich nenne hier die wesentlichen – aus meiner persönlichen Erfahrung und aus dem, was Fachliteratur und öffentlicher Diskurs zeigen.

Datenschutz: Das Intimste landet irgendwo

Was Menschen einer KI erzählen, ist oft das, was sie keiner anderen Person sagen würden. Scham, Trauma, Suizidgedanken. Diese Daten landen auf Servern – meist bei kommerziellen Unternehmen. Wer hat Zugriff? Werden sie zum Modell-Training genutzt? Die wenigsten Anbieter kommunizieren das transparent genug für einen therDatenschutz: Das Intimste landet irgendwoapeutisch sensiblen Kontext.

Rechtlich gelten KI-Anwendungen in der psychosozialen Versorgung in der EU als Hochrisiko-Systeme im Sinne des EU AI Acts (2024/2025). Sie unterliegen erhöhten Anforderungen an Transparenz, Risikomanagement und Datenverarbeitung. Die nationale Umsetzung dieser Vorgaben ist noch im Fluss – was bedeutet, dass Fachleute in einer Phase agieren, in der Regulierung vorhanden, aber noch nicht vollständig konkretisiert ist. Klarheit besteht darin: KI darf im psychotherapeutischen Kontext derzeit vor allem unterstützend eingesetzt werden. Autonome Krisenintervention oder Diagnosestellung ohne menschliche Aufsicht sind klar problematisch (Clarathy, 2025; Nature Digital Medicine, 2024).

Abhängigkeit und die Illusion der perfekten Beziehung

KI ist immer verfügbar, nie gerädt, stets geduldig. Das ist Stärke und Gefahr zugleich. Es gibt erste Hinweise in der Forschung, dass Menschen tatsächlich etwas erleben können, das einer digitalen therapeutischen Allianz ähnelt (JMIR Mental Health, 2025; PMC, 2022) – was zeigt, wie wirksam diese Interaktion sein kann, aber auch wie sehr sie verleiten kann, echte menschliche Beziehungen als anstrengender zu empfinden. Das wäre ein Verlust, denn Beziehungsfähigkeit ist oft genau das, worum es in der Therapie geht.

Bias, Automatisierungsbias und kulturelle Blindstellen

KI-Modelle wurden überwiegend auf westlich-akademischen, englischsprachigen Daten trainiert. Das bedeutet: Bestimmte Lebenswelten – aus dem Kontext von Armut, Rassismus, queerer Identität oder nicht-westlichen Heiltraditionen – werden schlechter abgebildet. Antworten können kulturell blind oder einseitig sein.

Hinzu kommt der Automatisierungsbias: die Tendenz, algorithmischen Einschätzungen mehr Vertrauen zu schenken als menschlichen. Das Risiko ist real: einseitige Antworten werden übernommen, weil sie von einer scheinbar objektiven Quelle kommen (Universimed, 2025; Klinik Friedenweiler, 2024).

Qualitätssicherung: Woran erkennt man gute Tools?

Nicht jede KI-Anwendung ist gleich. Wer – ob als Fachperson oder als Betroffene:r – ein Tool einsetzen möchte, sollte zumindest folgende Fragen stellen:

- Gibt es eine belastbare Evidenzlage für dieses Tool?

- Ist die Datenschutzpraxis transparent: Wo liegen die Daten? Werden sie zum Training genutzt?

- Gibt es klare Krisenpfade? Leitet das System bei akuter Gefährdung an menschliche Hilfe weiter?

- Ist der Zweck klar abgegrenzt? Wird KI als Unterstützung oder als Ersatz positioniert?

- Kann der therapeutische Prozess jederzeit vollständig menschlich geführt werden?

Welche Kompetenzen Fachleute brauchen

Aus meiner Perspektive als Betroffene – und als jemand, der KI selbst aktiv genutzt hat – möchte ich benennen, welche Kompetenzen ich mir von Fachpersonen wünsche, die KI in den therapeutischen Prozess einbeziehen. Es ist nicht meine Aufgabe, das für Fachleute zu definieren. Aber ich glaube, dass Betroffene eine Perspektive einbringen können, die in dieser Debatte selten vorkommt.

Empirische Arbeiten bestätigen: Therapeutinnen und Therapeuten benötigen kein technisches Expertenwissen, aber ein grundlegendes Verständnis von Funktionsweise, Limitationen und Risiken digitaler Tools (EvH Bochum, 2024). Ausbildungsinstitute werden heute aufgefordert, entsprechende Module zu Technologie, Datenschutz und Ethik zu integrieren.

Digitale Grundkompetenz

Was ist ein Sprachmodell? Was sind Halluzinationen – also Situationen, in denen KI selbstsicher falsche Dinge sagt? Ohne dieses Basisverständnis ist eine kritische Beurteilung nicht möglich.

Methodisches Urteilsvermögen und klare Indikation

Welche therapeutische Methode passt zu welchem KI-Einsatz? Welche Diagnosen eignen sich – und bei welchen ist Vorsicht oder ein Verzicht angezeigt? Das erfordert klinisches Wissen in Kombination mit einem realistischen Bild davon, was KI kann und was nicht.

Datenschutz- und Rechtskompetenz

Fachpersonen tragen Schweigepflicht. Diese Pflicht gilt auch, wenn sie ein Tool empfehlen. Wer KI-gestützte Anwendungen empfiehlt, muss deren Datenschutzpraxis kennen und das klar kommunizieren können. Nicht als Bürokratie – als Fürsorge (VIA Health, 2025).

Ethische Reflexionsfähigkeit

Was bedeutet es, wenn ein Mensch einer Maschine das äusserste Vertrauen schenkt? Wie verhindere ich, dass die therapeutische Beziehung durch das Delegieren an Algorithmen ausgehöhlt wird? Diese Fragen haben keine einfachen Antworten – und sie dürfen nicht einmalig gestellt werden.

Eigene Erfahrung mit KI

Ich halte das für entscheidend: Wer empfiehlt, sollte wissen, wovon er spricht. Nicht als Technikexperte, aber als jemand, der selbst erlebt hat, wie KI auf verletzliche Mitteilungen antwortet, wo sie hilft und wo sie ratlos macht. Das schärft das Urteilsvermögen auf eine Weise, die Literatur allein nicht leisten kann.

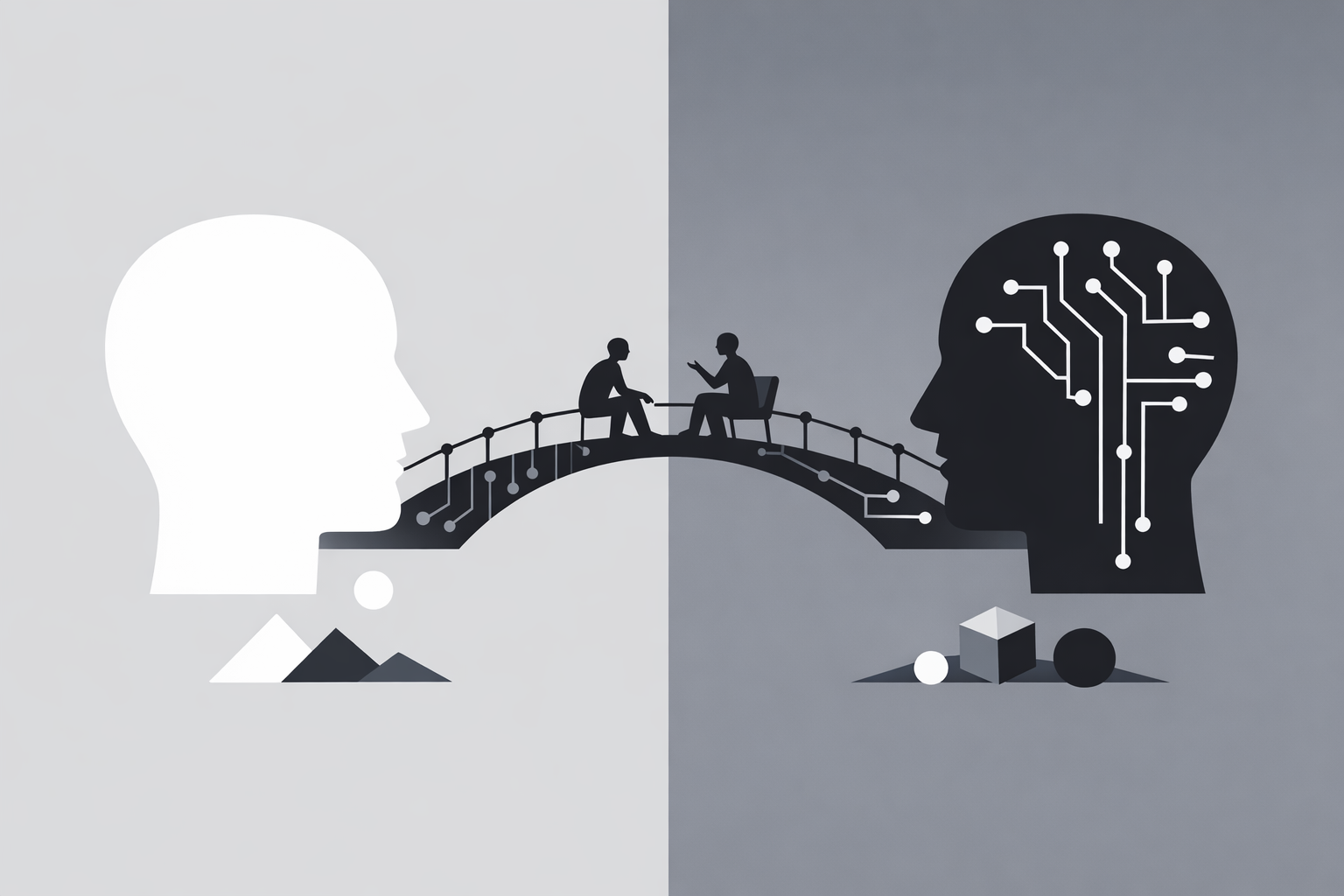

Die Brücke – und ihre Pfeiler

Eine Brücke verbindet zwei Ufer. Sie ist kein Zuhause. Sie ist der Weg dorthin.

KI kann in der Psychotherapie genau das sein: eine Brücke. Zwischen der Not und dem nächsten verfügbaren Therapieplatz. Zwischen der Sitzung und dem Alltag. Zwischen dem Wissen, das ein Mensch im therapeutischen Prozess erworben hat, und dem Moment, in dem er es wirklich braucht.

Aber Brücken brauchen Pfeiler. Die Pfeiler hier sind: eine tragfähige therapeutische Beziehung als Basis, fachliches Urteilsvermögen bei der Auswahl und Begleitung digitaler Tools, Datenschutzverantwortung und – ganz grundlegend – das Verständnis, dass psychisches Leid nicht vollständig an einen Algorithmus übergeben werden kann. Und darf.

Die Forschung steht hier noch am Anfang. Fragen rund um Explainable AI für therapeutische Prozesse, ethisch auditierbare Sprachmodelle und die Langzeitwirkung digitaler Interventionen sind offen. Fachleute und Betroffene, die heute mit KI arbeiten, sind Teil dieser Entwicklung – mit allen Möglichkeiten und allen Risiken, die das mit sich bringt.

Was ich mir wünsche: eine Kultur des neugierigen Ernstes in dieser Debatte. Weder die Begeisterung, die Risiken übersieht, noch die Skepsis, die Möglichkeiten verweigert. Sondern Menschen – Fachleute wie Betroffene – die gemeinsam herausfinden, wie diese Technologie dem dienen kann, was Therapie immer schon wollte: Menschen zurück zu sich selbst zu bringen.

Mr. Ping würde das wohl so sagen: „Das Geheimrezept bist immer noch du.“

— Ende —

Quellenverzeichnis

Wissenschaftliche Studien

- Fitzpatrick, K., Darcy, A. & Vierhile, M. (2017). Delivering Cognitive Behavior Therapy to Young Adults With Symptoms of Depression Using a Fully Automated Conversational Agent (Woebot). JMIR Mental Health, 4(2), e19.

- Frontiers in Psychiatry (2025). Effectiveness of artificial intelligence chatbots on mental health. doi: 10.3389/fpsyt.2025.1621768

- JMIR Mental Health (2025). Does the Digital Therapeutic Alliance Exist? Integrative Review. doi: 10.2196/69294

- Nature Digital Medicine (2024). Navigating the European Union Artificial Intelligence Act for Healthcare. nature.com/articles/s41746-024-01213-6

- PMC / JMIR (2022). Evaluating the Therapeutic Alliance With a Free-Text CBT Chatbot. PMC9035685

- PMC (2025). Chatbot-Delivered Interventions for Improving Mental Health. PMC12261465

- PMC (2025). Systematic review of artificial intelligence enabled psychological interventions. PMC12373353

Fachpublikationen, Berichte und Praxisquellen

- AOK / Gesundheit & Gesellschaft (2026). Auf der Couch zwischen Mensch und Maschine. aok.de

- Clarathy (2025). KI iFachpublikationen, Berichte und Praxisquellenn der Therapie 2025: Was ist erlaubt? clarathy.de/blog/ki-in-der-therapie-erlaubt-was-darf-ich

- EvH Bochum (2024). Neue Studie: KI in der Psychotherapie? evh-bochum.de

- HelloBetter (2024). KI in der Psychotherapie: Von Chatbots bis Therapieunterstützung. hellobetter.de

- ICT&Health (2025). First EU AI Act guidelines: When is health AI prohibited? icthealth.org

- It’s Complicated (2025). AI Report 2025: Neue Daten zu KI in der Psychotherapie. complicated.life

- Klinik Friedenweiler (2024). Chancen von KI in der Psychotherapie. klinik-friedenweiler.de

- Psychotherapeutenjournal (2025). Chance oder Risiko? KI-basierte Tools in der Psychotherapie. psychotherapeutenjournal.de

- Universimed (2025). Künstliche Intelligenz in der Psychotherapie: ethische Herausforderungen. universimed.com

- VIA Health (2025). KI in der Psychotherapie: Rechtliche Einordnung und Datenschutz. via-health.de

- World Economic Forum (2025). How blended care can improve mental health support systems. weforum.org